이 노트북은 인터랙티브 노트북입니다. 로컬에서 실행하거나 아래 링크를 사용할 수 있습니다:

오디오 데이터에 Weave 사용하기: OpenAI 예제

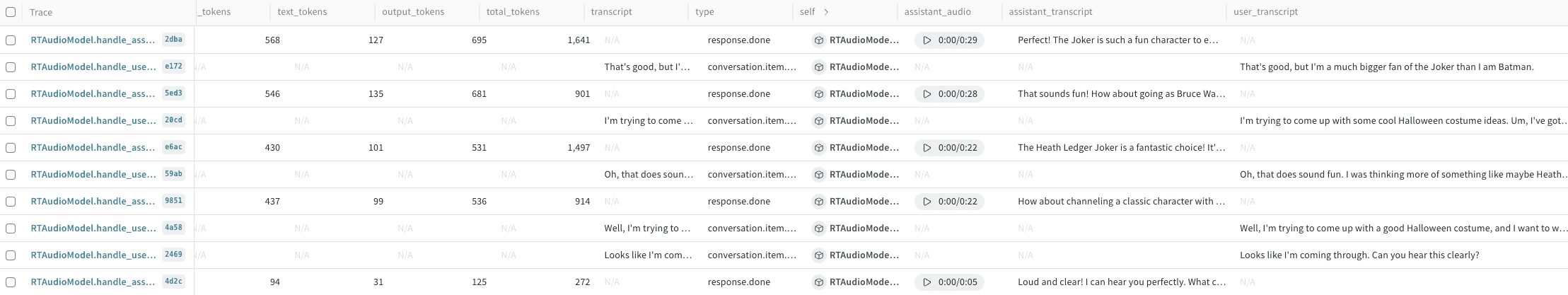

이 데모에서는 OpenAI chat completions API와 GPT 4o Audio Preview를 사용하여 텍스트 프롬프트에 대한 오디오 응답을 생성하고 이를 Weave에서 추적하는 방법을 보여줍니다.

설정

먼저 OpenAI (openai)와 Weave (weave) 종속성, 그리고 API 키 관리를 위한 set-env를 설치합니다.

set_env를 사용하며, 이는 Colab 전용인 google.colab.userdata를 대체할 수 있는 대안입니다. 사용법은 여기를 참조하세요.

오디오 스트리밍 및 저장 예제

이제 오디오 모달리티가 활성화된 OpenAI completions 엔드포인트 호출을 설정하겠습니다. 먼저 OpenAI 클라이언트를 생성하고 Weave 프로젝트를 시작합니다.prompt_endpont_and_log_trace 함수를 정의합니다. 이 함수는 세 가지 주요 단계로 구성됩니다:

-

텍스트 및 오디오 입출력을 지원하는

GPT 4o Audio Preview모델을 사용하여 completion 오브젝트를 생성합니다.- 모델이 다양한 억양으로 천천히 13까지 세도록 프롬프트를 작성합니다.

- completion을 “stream”으로 설정합니다.

- 스트리밍된 데이터가 청크별로 기록될 새로운 출력 파일을 엽니다.

- Weave가 trace에 오디오 데이터를 로그할 수 있도록 오디오 파일의 파일 핸들러를 반환합니다.

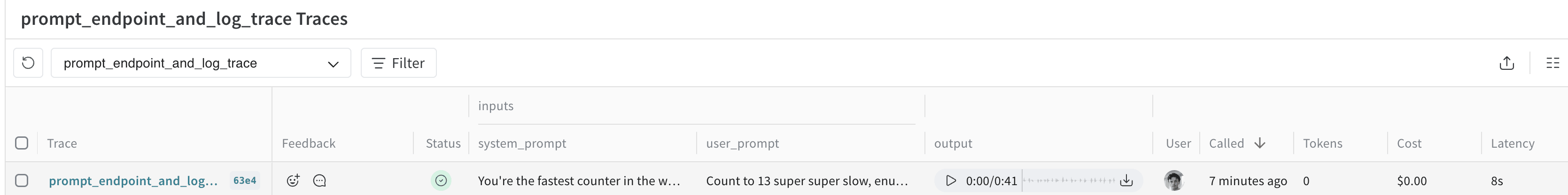

테스트

다음 셀을 실행하세요. 시스템 및 사용자 프롬프트와 출력 오디오가 Weave trace에 저장됩니다. 셀 실행 후, ”🍩” 이모지 옆의 링크를 클릭하여 trace를 확인하세요.심화 사용법: Weave와 함께 Realtime Audio API 사용하기